-

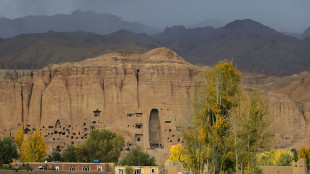

Trasladan a Kabul a los muertos y heridos del ataque a turistas en localidad afgana de Bamiyán

Trasladan a Kabul a los muertos y heridos del ataque a turistas en localidad afgana de Bamiyán

-

Ministro del gabinete de guerra israelí afirma que dimitirá si no se aprueba un plan para Gaza

-

Optimismo sobre el estado del primer ministro eslovaco, su presunto atacante en prisión preventiva

Optimismo sobre el estado del primer ministro eslovaco, su presunto atacante en prisión preventiva

-

Ambientalistas recrean casi 200 años después viaje de Darwin a Galápagos

-

Los médicos son optimistas ante estado de salud del primer ministro eslovaco tras el atentado

Los médicos son optimistas ante estado de salud del primer ministro eslovaco tras el atentado

-

Seis muertos en archipiélago francés del Pacífico donde el ejército trata de imponer el orden

-

Zelenski se prepara para una ofensiva mayor en norte y este de Ucrania, Rusia sigue avanzando

Zelenski se prepara para una ofensiva mayor en norte y este de Ucrania, Rusia sigue avanzando

-

El sospechoso del atentado contra el primer ministro eslovaco llega al tribunal

-

Gaza recibe un primer cargamento de ayuda humanitaria tras varios días de bloqueo

Gaza recibe un primer cargamento de ayuda humanitaria tras varios días de bloqueo

-

Unos 10.000 evacuados en la región ucraniana de Járkov debido a la ofensiva rusa

-

En venta último terreno privado de estratégico archipiélago en el Ártico

En venta último terreno privado de estratégico archipiélago en el Ártico

-

México y Guatemala acuerdan atender "causas estructurales" de la migración

-

Corea del Norte confirma lanzamiento de misil balístico, Kim promete impulsar fuerza nuclear

Corea del Norte confirma lanzamiento de misil balístico, Kim promete impulsar fuerza nuclear

-

Sube a siete el balance de muertos por tormenta en el sur de EEUU

-

OpenAI (ChatGPT) desmantela unidad sobre riesgos futuros de esta teconología

OpenAI (ChatGPT) desmantela unidad sobre riesgos futuros de esta teconología

-

Unicef: Es imposible predecir qué pasará si Panamá cierra selva a migrantes

-

El muro "anti-Haití", bandera electoral en República Dominicana

El muro "anti-Haití", bandera electoral en República Dominicana

-

¿Abinader o Fernández? Dos viejos rivales buscan revancha en República Dominicana

-

Violada y forzada a ser madre, una mujer acusa a Honduras ante la ONU

Violada y forzada a ser madre, una mujer acusa a Honduras ante la ONU

-

La ofensiva rusa en Ucrania puede intensificarse, advierte Zelenski en una entrevista con la AFP

-

Cuatro muertos, tres de ellos turistas españoles, en un tiroteo en Afganistán

Cuatro muertos, tres de ellos turistas españoles, en un tiroteo en Afganistán

Entwickler von Künstlicher Intelligenz bei Google warnt eindringlich vor Gefahren

Erneut warnt ein Experte vor einer unkontrollierbaren Entwicklung besonders fortgeschrittener Künstlicher Intelligenz (KI). Geoffrey Hinton, führender KI-Entwickler beim US-Konzern Google, kündigte seinen Job und mahnte in der "New York Times" vom Montag, die Fortschritte im Feld der KI bedeuteten "ernste Risiken für die Gesellschaft und für die Menschheit". Hinton wird laut Zeitung auch "Godfather" der KI genannt.

Er sagte der Zeitung, der Wettbewerb bringe die Technologieunternehmen dazu, "in einem gefährlichen Tempo" immer neue KI zu entwickeln. Damit breiteten sich Falschinformationen aus und Arbeitsplätze gerieten in Gefahr. "Es ist schwierig sich vorzustellen, wie man die Bösen daran hindert, KI für böse Dinge einzusetzen", sagte Hinton.

Google und das Unternehmen OpenAI - das Startup, das den bekannten Chatbot ChatGPT entwickelt hat - begannen im vergangenen Jahr damit, lernende Systeme zu entwickeln, die dafür eine sehr viel größere Datenmenge als zuvor nutzen. Hinton sagte der "New York Times", diese Systeme würden aufgrund der schieren Datenmenge die menschliche Intelligenz in mancher Hinsicht in den Schatten stellen.

Mit Blick auf die Arbeitsplätze sagte Hinton etwa, Künstliche Intelligenz könne die "Sklavenarbeit" überflüssig machen. "Aber sie könnte noch viel mehr wegnehmen."

Der Zeitung zufolge kündigte der Entwickler seinen Job bei Google im vergangenen Monat. Sein Chef im Unternehmen, Jeff Dean, erklärte in einer Mitteilung an US-Medien, er danke Hinton für seine Arbeit. Dean betonte, Google habe als eines der ersten Unternehmen Leitsätze für die KI-Anwendung veröffentlicht. Google fühle sich auch weiterhin "zu einem verantwortungsvollen Umgang mit KI verpflichtet". Google lerne beim Verständnis der Risiken beständig dazu - und führe gleichzeitig weiterhin "kühn" Neuerungen ein.

Erst Ende März hatten der Technologie-Milliardär Elon Musk und zahlreiche Experten eine Pause bei der Entwicklung von besonders fortgeschrittener Künstlicher Intelligenz gefordert. "KI-Systeme mit einer Intelligenz, die Menschen Konkurrenz macht, können große Risiken für Gesellschaft und Menschheit bergen", warnten auch sie. "Mächtige KI-Systeme sollten erst dann entwickelt werden, wenn wir zuversichtlich sind, dass ihre Auswirkungen positiv und ihre Risiken kontrollierbar sind."

In einem offenen Brief zu einem Stopp der KI-Entwicklung verwiesen die Unterzeichner auf einen Satz von OpenAI-Gründer Sam Altman, demzufolge irgendwann eine "unabhängige" Überprüfung notwendig sei, bevor mit dem Training neuer Systeme begonnen werde. "Wir stimmen zu", schreiben die Verfasser des Briefes. "Der Zeitpunkt ist jetzt."

F.Pavlenko--BTB