-

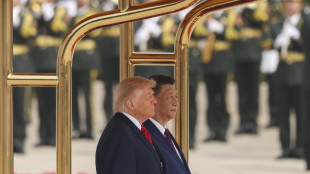

Trump, 'da Xi Jinping nessuna minaccia agli Usa su Taiwan'

Trump, 'da Xi Jinping nessuna minaccia agli Usa su Taiwan'

-

Internazionali: Sinner-Medvedev rinviata per pioggia, domani non prima delle 15

-

Pallavolo: 3-0 alla Francia nel secondo test delle azzurre di Velasco

Pallavolo: 3-0 alla Francia nel secondo test delle azzurre di Velasco

-

Travolta Palma d'onore a sorpresa, 'nel mio film da regista invito a speranza

-

Il programma di domani a Cannes. Driver-Johansson, IA e Bardem in gara

Il programma di domani a Cannes. Driver-Johansson, IA e Bardem in gara

-

Gli Usa annunciano una proroga di 45 giorni della tregua tra Israele e Libano

-

Travolta, Palma d'onore a sorpresa, 'mi riempie di umiltà'

Travolta, Palma d'onore a sorpresa, 'mi riempie di umiltà'

-

Giuria non trova accordo e il giudice annulla il processo a Weinstein

-

Internazionali: Darderi, "chiedo scusa al pubblico, ma ero senza benzina"

Internazionali: Darderi, "chiedo scusa al pubblico, ma ero senza benzina"

-

Sheinbaum parla con Trump, focus su sicurezza e commercio

-

Internazionali: Ruud 'amo l'Italia, pronto per la finale'

Internazionali: Ruud 'amo l'Italia, pronto per la finale'

-

Al Salone del Libro 'Viaggiare con Leggerezza' con Ferrovie

-

Internazionali: sfuma il sogno di Darderi, Ruud primo finalista

Internazionali: sfuma il sogno di Darderi, Ruud primo finalista

-

A Cannes la Cina è vicina, Hollywood latita e Giappone e Asia dominano

-

Da un paradosso un laser super-preciso per studiare il cervello

Da un paradosso un laser super-preciso per studiare il cervello

-

Hit Parade, Sayf conquista subito la vetta con Santissimo

-

Il prezzo del gas chiude in rialzo oltre i 50 euro al megawattora

Il prezzo del gas chiude in rialzo oltre i 50 euro al megawattora

-

Borsa: Milano in calo con l'Europa, scivolano Stm e Buzzi

-

Media, Putin il 20 maggio da Xi, pochi giorni dopo la visita di Trump

Media, Putin il 20 maggio da Xi, pochi giorni dopo la visita di Trump

-

'L'intelligenza artificiale aiuta il lavoro di chi comunica, ma non lo sostituisce'

-

Fissato all'11 giugno il tavolo al Mimit sulle vertenze Sulcis

Fissato all'11 giugno il tavolo al Mimit sulle vertenze Sulcis

-

A Cannes c'e' anche la Palestina che resiste

-

Trump, 'non voglio che Taiwan dichiari l'indipendenza e si scateni una guerra'

Trump, 'non voglio che Taiwan dichiari l'indipendenza e si scateni una guerra'

-

Angioplastica in ospedale per l'ex regina Margrethe di Danimarca

-

Alle sfilate di Milano addio alle pellicce

Alle sfilate di Milano addio alle pellicce

-

Borsa: Milano chiude in calo dell'1,87%

-

Il primo panda gigante in Indonesia pronto a incantare il pubblico

Il primo panda gigante in Indonesia pronto a incantare il pubblico

-

Mondiali: i convocati della Costa d'Avorio, la novità é l'interista Bonny

-

Fatti di alghe e meccanismi, i microrobot che volano in sciami

Fatti di alghe e meccanismi, i microrobot che volano in sciami

-

Il Cda di Autobrennero approva il bilancio, utile netto a 89,1 milioni

-

Giro: Vingegaard attacca sul Blockhaus e vince la 7/a tappa

Giro: Vingegaard attacca sul Blockhaus e vince la 7/a tappa

-

Atletica: a Shangai parte la Diamond League, occhi su Duplantis

-

Norwegian Cruise torna a Trieste, 11 scali nel 2026 e 25mila passeggeri

Norwegian Cruise torna a Trieste, 11 scali nel 2026 e 25mila passeggeri

-

Colombia, i dissidenti Farc annunciano il cessate il fuoco per le elezioni

-

Alla Farnesina formazione per supporto psicologico nelle aree di crisi

Alla Farnesina formazione per supporto psicologico nelle aree di crisi

-

L'Arena di Verona Opera Festival si allunga, 53 serate da giugno a settembre

-

E' ufficiale, Amazon ha aperto la caccia al nuovo James Bond

E' ufficiale, Amazon ha aperto la caccia al nuovo James Bond

-

Huller, sento il senso di colpa per il passato nazista della Germania

-

Il compositore Stefano Mainetti fra i tre finalisti dei Camille Awards 2026

Il compositore Stefano Mainetti fra i tre finalisti dei Camille Awards 2026

-

Pechino, Xi effettuerà una visita negli Usa in autunno

-

MotoGP: ad Acosta le prequalifiche, Bagnaia e Martin dovranno passare la Q1

MotoGP: ad Acosta le prequalifiche, Bagnaia e Martin dovranno passare la Q1

-

Pascal e Weaver alla prima di The Mandalorian, un film su un bravo padre

-

Balzo dei titoli di Stato, il Btp sale di 16 punti al 3,92%

Balzo dei titoli di Stato, il Btp sale di 16 punti al 3,92%

-

Rolling Stones come negli anni '70, band ringiovanita in video di In the Stars

-

Borsa: l'Europa in calo dopo Wall Street, Milano -2%

Borsa: l'Europa in calo dopo Wall Street, Milano -2%

-

Anche Libera partecipa al Vasco Live 2026

-

Il livello del mare è regolato anche dalla rotazione della Terra

Il livello del mare è regolato anche dalla rotazione della Terra

-

Fortuna FuturClassica, giovani talenti internazionali in scena a Roma

-

Mondiali: i convocati del Giappone, fuori la stella Mitoma per infortunio

Mondiali: i convocati del Giappone, fuori la stella Mitoma per infortunio

-

Da San Siro al Duomo, l'Inter svela il percorso della parata scudetto

La capacità di giudizio dell'IA è solo apparenza

Grandi rischi nel delegare scelte e giudizi agli Llm

La capacità di giudizio dei modelli linguistici come ChatGpt o Gemini è solo apparenza: a dimostrarlo è lo studio guidato da Walter Quattrociocchi, dell'Università Sapienza di Roma, e pubblicato sulla rivista dell'Accademia Nazionale degli Stati Uniti Pnas. Un lavoro che sottolinea i rischi concreti di affidare a questi modelli di Intelligenza Artificiale la delega di fare scelte o prendere decisioni. "Cosa avviene realmente quando chiediamo a un'IA di eseguire una scelta, ad esempio determinare se una notizia del web sia credibile o è piuttosto una fake news?", ha detto Quattrociocchi all'ANSA per raccontare il nuovo studio che ha eseguito una serie di test a gran parte dei più importanti modelli linguisti Llm in circolazione, come ChatGpt, Gemini, Llama, Deepseek e Mistral. Un lungo lavoro che ha messo a confronto umani e IA per capire le differenze di 'ragionamento' dei due. "Quello che abbiamo messo qui molto bene in evidenza è che nonostante i risultati, le IA riconosco infatti molto bene le fake news, il meccanismo che utilizzano non si basa però su riscontri reali ma su una mera capacità di simulare i giudizi. In altre parole, i giudizi formulati dagli Llm sono plausibili ma disancorati dalla realtà fattuale". Una sostituzione della verità con la plausibilità che in un futuro non molto lontano, sottolineano gli autori, potrebbe portare a problemi gravi quando gradualmente daremo sempre più autorevolezza alle capacità degli Llm di gestire azioni o prendere scelte per noi, in totale delega. "Ma questi sistemi sembrano valutare come noi solo perché simulano le tracce del pensiero, non il pensiero stesso", ha aggiunto il ricercatore italiano. "Questo studio - ha concluso - dimostra che ciò che stiamo automatizzando non è il giudizio, ma la sua apparenza".

Y.Bouchard--BTB